دیپفیک (DeepFake) چیست؟ بررسی کامل یکی از شگفتانگیزترین و خطرناکترین فناوریهای هوش مصنوعی

دیپفیک (DeepFake) چیست؟ بررسی کامل یکی از شگفتانگیزترین و خطرناکترین فناوریهای هوش مصنوعی

مقدمه

با پیشرفت چشمگیر فناوریهای هوش مصنوعی در سالهای اخیر، پدیدهای به نام «دیپفیک» (DeepFake) توجه بسیاری را به خود جلب کرده است. از ویدیوهایی که افراد مشهور را در حال انجام یا گفتن چیزهایی نشان میدهد که هرگز انجام ندادهاند، گرفته تا بدلسازی چهره در فیلمها، دیپفیک به یکی از جذابترین و در عین حال نگرانکنندهترین دستاوردهای AI تبدیل شده است.

در این مقاله، بهطور کامل با دیپفیک آشنا میشویم: تعریف آن، نحوهی عملکرد، کاربردها، تهدیدات، روشهای شناسایی و آیندهی این فناوری. این مطلب یک راهنمای جامع برای تمام کسانی است که به دنبال درک بهتر دیپفیک هستند؛ چه در حوزهی فناوری، چه امنیت و چه رسانه.

دیپفیک چیست؟ (DeepFake تعریف)

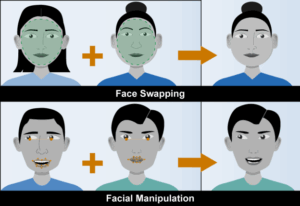

دیپفیک ترکیبی از دو واژهی “Deep Learning” (یادگیری عمیق) و “Fake” (جعلی) است. این اصطلاح به فناوریای اطلاق میشود که از مدلهای پیشرفته یادگیری ماشین برای ساخت یا تغییر تصاویر، صدا و ویدیو به گونهای استفاده میکند که واقعی به نظر برسند، در حالی که در واقع جعلی هستند.

به بیان سادهتر، با استفاده از دیپفیک میتوان چهرهی یک فرد را بهصورت دیجیتالی روی چهرهی فرد دیگری قرار داد یا صدای فردی را با دقت بالا شبیهسازی کرد.

دیپفیک چگونه کار میکند؟ (مبانی فنی)

فناوری دیپفیک عمدتاً مبتنی بر شبکههای عصبی مصنوعی و بهویژه مدلهای Generative Adversarial Networks (GANs) است. GAN از دو بخش تشکیل شده است:

-

Generator (تولیدکننده): تصویری جعلی تولید میکند.

-

Discriminator (تشخیصدهنده): سعی میکند تشخیص دهد که تصویر واقعی است یا جعلی.

این دو مدل در یک رقابت دائمی قرار میگیرند و در نتیجه، کیفیت خروجیها بهطور مداوم بهبود مییابد تا زمانی که تصاویر یا ویدیوهای تولیدی، تقریباً از نمونههای واقعی قابل تمایز نباشند.

انواع دیپفیک

1. ویدیو دیپفیک

شایعترین نوع دیپفیک، ویدیوهایی هستند که چهره یا صدای یک فرد را با شخص دیگری جایگزین میکنند.

2. صدا (Voice DeepFake)

شبیهسازی صدا با استفاده از هوش مصنوعی امکانپذیر شده است. این فناوری میتواند صدای افراد را تقلید کرده و جملاتی تولید کند که هرگز گفته نشدهاند.

3. عکسهای جعلی (Image DeepFake)

تصاویر ثابت نیز میتوانند جعلی باشند، مانند تصاویر افراد غیرواقعی تولیدشده با AI یا تغییر چهره در عکسهای موجود.

کاربردهای مثبت دیپفیک

در حالی که دیپفیک بیشتر با خطرات و تهدیدات همراه است، اما در برخی موارد میتواند بسیار مفید باشد.

۱. صنعت سینما و جلوههای ویژه

با استفاده از دیپفیک میتوان چهرهی بازیگران را بدون نیاز به حضور فیزیکی در صحنه تغییر داد یا بازسازی بازیگران فوتشده را انجام داد.

۲. آموزش و شبیهسازی

مدرسین یا متخصصین میتوانند با استفاده از دیپفیک، سناریوهای آموزشی تعاملی و واقعگرایانه طراحی کنند.

۳. کمک به افراد دچار نقص گفتاری

افرادی که توانایی صحبت کردن خود را از دست دادهاند، میتوانند با دیپفیک صوتی، صدای خود را بازسازی کنند.

تهدیدات و خطرات دیپفیک

1. اطلاعات نادرست (Fake News)

یکی از خطرناکترین جنبههای دیپفیک، استفاده از آن در ساخت ویدیوهای جعلی سیاسی یا اجتماعی است که میتواند افکار عمومی را به اشتباه بیندازد.

2. اخاذی و باجگیری

تولید محتوای جعلی برای تخریب شخصیت یا اخاذی مالی یکی از نگرانیهای اصلی است.

3. نقض حریم خصوصی

تصاویر و ویدیوهای افراد میتوانند بدون رضایتشان مورد استفاده قرار گرفته و محتوای نامناسب تولید شود.

4. تخریب چهره برندها

افراد یا شرکتهای رقیب ممکن است ویدیوهایی جعلی منتشر کنند که اعتبار برند را زیر سوال ببرد.

تشخیص دیپفیک: آیا ممکن است؟

تشخیص محتوای دیپفیک با چشم غیرمسلح بسیار سخت است، اما ابزارها و روشهایی برای شناسایی آنها وجود دارد:

-

تحلیل فریمبهفریم: بررسی ناهماهنگی در نور، پلکزدن، حرکت دهان و جزئیات صورت

-

استفاده از نرمافزارهای تخصصی تشخیص فیک

-

بررسی متادیتا فایلها

-

تشخیص الگوریتمی با کمک مدلهای یادگیری ماشین معکوس

گوگل، فیسبوک و مایکروسافت ابزارهایی برای شناسایی دیپفیک توسعه دادهاند، اما این حوزه همچنان در حال توسعه است.

نمونههای واقعی از دیپفیکهای جنجالی

-

ویدیو جعلی باراک اوباما که توسط شرکت Buzzfeed ساخته شد تا خطر دیپفیکها را نشان دهد.

-

ویدیوی جعلشده زلنسکی که در آن رئیسجمهور اوکراین به مردمش دستور تسلیم میدهد (کاملاً ساختگی بود).

-

DeepNude اپلیکیشنی که میتوانست لباس افراد را بهصورت جعلی حذف کند و خیلی زود ممنوع شد.

دیپفیک در ایران

در ایران نیز این فناوری مورد توجه قرار گرفته و هم در زمینههای سرگرمی و هم در زمینههای تبلیغاتی مورد استفاده است. با افزایش دسترسی به ابزارهای AI، شاهد گسترش استفادههای درست و نادرست از دیپفیک هستیم.

قوانین و مقررات درباره دیپفیک

در بسیاری از کشورها مانند آمریکا، چین، انگلستان و اتحادیه اروپا، استفاده نادرست از دیپفیک جرم تلقی شده است. ایران نیز در حال تدوین قوانینی برای مقابله با نشر محتوای جعلی با استفاده از فناوریهای نوین است.

آینده دیپفیک: تهدید یا فرصت؟

دیپفیک مانند هر فناوری دیگری یک تیغ دو لبه است. استفادهی صحیح از آن میتواند به توسعهی هنر، آموزش، پزشکی و تعاملات انسانی کمک کند، اما استفادهی نادرست میتواند بنیان اعتماد در جامعه را از بین ببرد.

در آینده احتمالاً شاهد فناوریهای تشخیص سریعتر و دقیقتر دیپفیک خواهیم بود و شرکتهای بزرگ فناوری به دنبال مقابلهی فعالانه با سوءاستفاده از آن هستند.

ابزارهای محبوب ساخت دیپفیک

در ادامه برخی از ابزارهای معروف دیپفیک را معرفی میکنیم:

| نام ابزار | نوع محتوا | قابلیت ویژه |

|---|---|---|

| DeepFaceLab | ویدیو | متنباز و قدرتمند |

| Zao | ویدیو | اپ موبایلی پرطرفدار در چین |

| Reface | ویدیو | تعویض چهره در لحظه |

| Descript Overdub | صدا | شبیهسازی صدا با دقت بالا |

| Synthesia | ویدیو | ساخت آواتار سخنگو با AI |

دیپفیک یک فناوری جذاب، قدرتمند و البته پرخطر است. در حالی که میتواند ابزار مفیدی برای خلاقیت، آموزش و فناوری باشد، استفادهی نادرست از آن میتواند نتایج فاجعهباری به دنبال داشته باشد.

برای بهرهبرداری صحیح از دیپفیک، لازم است قوانین و اخلاق حرفهای رعایت شود و آگاهی عمومی دربارهی آن افزایش یابد.

مقالهی روبرو از چاکوتا خوندنش پیشنهاد میشه: 10 تا از بهترین هوش مصنوعی های تولید تصویر

خوندن مطلب روبرو هم پیشنهاد میشه: DeepFake Wikipedia